为提高效率,提问时请提供以下信息,问题描述清晰可优先响应。

- 【TiDB 版本】:v3.0.5

- 【问题描述】:监控数据异常,请问如何修正

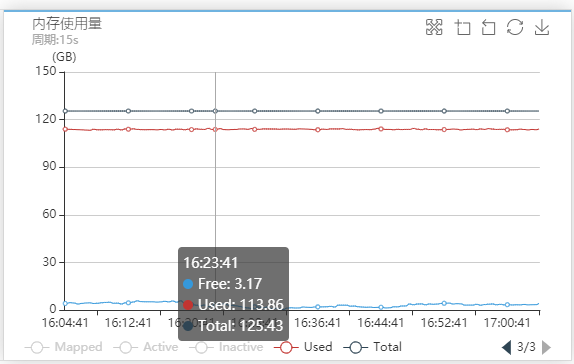

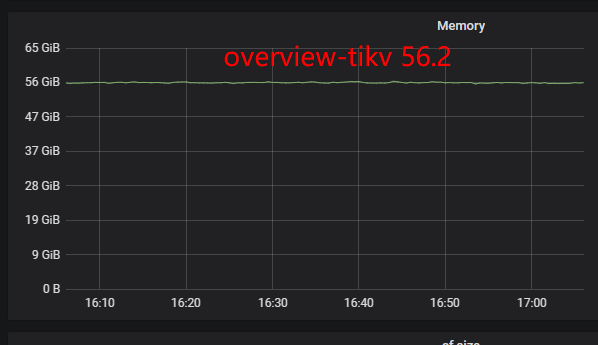

您好: 您把实例和ip都隐藏了,但是从监控看,应该是符合的。 tikv里的内存是实例的内存值,你可以把同一个实例的内存相加。 overview里的可用内存也能看到这些实例几乎没有可以使用的内存了。

不正常吧 overview里面实例也是十个,并不是双实例展示,就点一台机器给你看吧

您好:

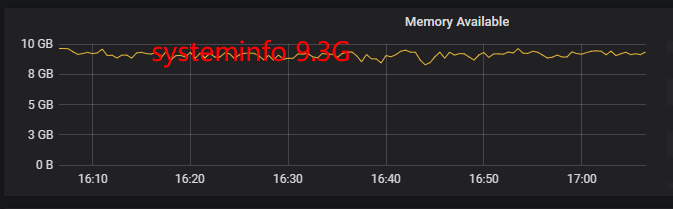

单从你的这一点说就监控不正常,overview里面的显示是一台机器的并没有把实例分开来,我有10台tikv机器,20个实例,但是overview里面只显示了10个机器的,内存使用率并没有对上,3.0版本的是按机器显示的;2.0版本的有分实例显示

您好:

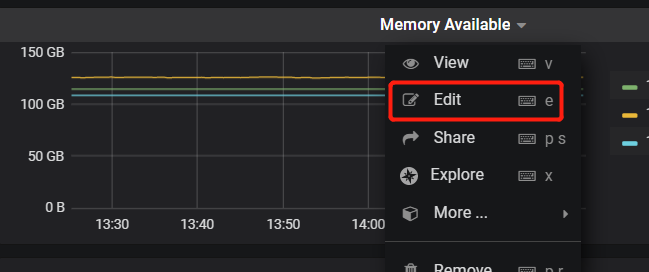

1. 这里是我之前修改过,查看了新的集群,overview这里是node_memory_MemAvailable_bytes是节点的内存。 你可以看一下你的grafana监控里是如何取值的.

2. 对于解释你的问题,这是实例需要相加,还有什么疑问吗?

你好:

1. 我看不到你的截图,但是从测试环境看,这里展示了每个实例的内存信息

没有隐藏。截图里面就是十个ip。所有服务器都只展示了一个。我2.0的集群是可以展示全部的

您好:

1. 麻烦截图看一下inventory.ini的信息

2. 这里看到的都是20180的实例,其他实例是有过一次扩容吗?

3. 挑选任意一台只展示一个tikv实例的服务器,执行以下命令,查看是否展示本机的监控指标:

curl http://<ip>:<tikv_status_port>/metrics | more

,,,我的tikv的端口是20171,20172这种的,,,没有20180 curl 监控界面上的端口2017的拿不到信息,20180能拿到信息,,是哪里的配置有问题吗 懵逼了

1.inventory.ini

3.这个问题我已经回答了,20180有返回信息。20171、20172没有

机器上检测端口发现 端口都存在,

我没看错…

从你的配置里看应该是20171和20172,所以希望可以确认下,为什么展示的不一致,不是说你看错了。 现在需要查看问题。是否有可能是source 源的问题,在排查问题。