【 TiDB 使用环境】生产环境 /测试/ Poc

【 TiDB 版本】 v6.1.2

【复现路径】做过哪些操作出现的问题

【遇到的问题:问题现象及影响】

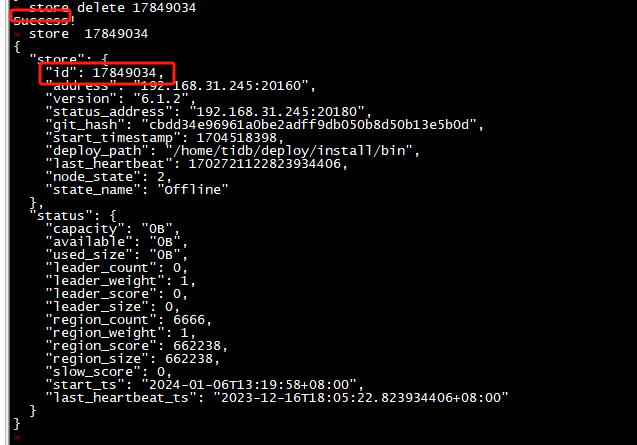

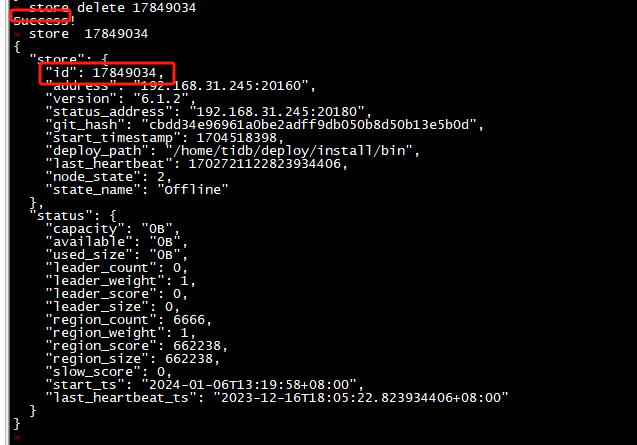

执行扩容后,提示store 存在,按照官网提供的操作用store delete 17849034 命令删除后结果还是存在,导致该节点启动不了。

【资源配置】进入到 TiDB Dashboard -集群信息 (Cluster Info) -主机(Hosts) 截图此页面

【附件:截图/日志/监控】

强调文本

【 TiDB 使用环境】生产环境 /测试/ Poc

【 TiDB 版本】 v6.1.2

【复现路径】做过哪些操作出现的问题

【遇到的问题:问题现象及影响】

执行扩容后,提示store 存在,按照官网提供的操作用store delete 17849034 命令删除后结果还是存在,导致该节点启动不了。

【资源配置】进入到 TiDB Dashboard -集群信息 (Cluster Info) -主机(Hosts) 截图此页面

【附件:截图/日志/监控】

强调文本

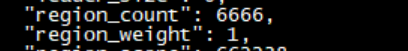

上面还有region没迁移结束啊,等offline变成tombstone就行了

看region_count

你是怎么操作的,先扩容再缩容?扩容完成了吗?下线就用的store delete,没用tiup?

先缩容,我看到提示成功了,我就扩容,扩容的时候发现启动不了。然后在官网上看到说用store delete,但是删除不了。现在也启动不了。

删除以前的数据,不是正常缩容的吧。这种情况一般是异常删除tikv,但是pd还有store的数据。应急的方式,重新扩容一个tikv把端口都改了,应该就能启动了,然后再来处理这个store。这个store没啥用的话,先删除region,然后再删除store

正常不都是先扩容在缩容吗?你有几个tikv节点

3个tikv 节点。

怎么个意思

你三个tikv,怎么可能先缩容,再扩容呢?必须要先扩容再缩容,因为你缩容的时候, 要缩容那台tikv节点上的region没有地方迁移啊。。。。你用tiup先扩容一个tikv节点出来吧。。。。这个缩容的region有地方迁移,自然就能缩容掉了

正解了

楼上说的对

3 副本最少 3 个 TiKV 节点,正常缩容是缩不下去的啊

3副本3tikv我记得缩容执行会卡主的,要不调整成一个副本再缩