zlgwarm

(Zlgwarm)

1

为提高效率,请提供以下信息,问题描述清晰能够更快得到解决:

【 TiDB 使用环境】

测试环境

【概述】 场景 + 问题概述

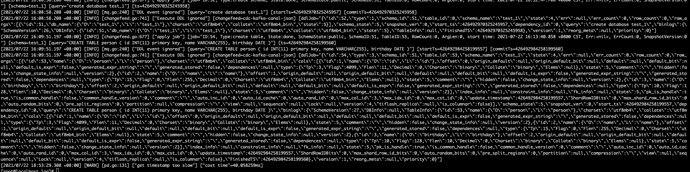

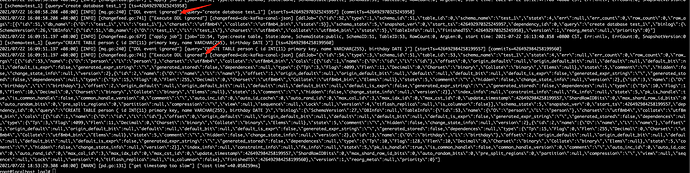

使用ticdc同步数据到下游kafka。。kafka消费发现没有数据。下面图片是cdc.log

我手动插入的数据有,但是通过tidb插入的数据没有

【备份和数据迁移策略逻辑】

【背景】 做过哪些操作

【现象】 业务和数据库现象

【问题】 当前遇到的问题

【业务影响】

【TiDB 版本】

【附件】

- 相关日志、配置文件、Grafana 监控(https://metricstool.pingcap.com/)

- TiUP Cluster Display 信息

- TiUP CLuster Edit config 信息

- TiDB-Overview 监控

- 对应模块的 Grafana 监控(如有 BR、TiDB-binlog、TiCDC 等)

- 对应模块日志(包含问题前后 1 小时日志)

若提问为性能优化、故障排查类问题,请下载脚本运行。终端输出的打印结果,请务必全选并复制粘贴上传。

1 个赞

xfworld

(魔幻之翼)

2

从你发的图上看,好像 DDL 都被忽略掉了,binlog 的明细里面也没有 DDL 的信息

zlgwarm

(Zlgwarm)

3

我的配置文件里面是true啊,为什么会被过滤的呢?

xfworld

(魔幻之翼)

4

发帖子,发问题,都不发版本

canal-json 有版本要求的,好像低于4.0.9 就不支持…

zlgwarm

(Zlgwarm)

5

1.5.3 tiup

Go Version: go1.16.5

Git Ref: v1.5.3

GitHash: 222bd4d460eaa3fb6feec6ddeb8612fe0870ffd3

tidb 5.1.1

ctl 5.1.1

zlgwarm

(Zlgwarm)

7

tiup ctl:v5.1.1 cdc changefeed create --pd=http://192.168.104.75:2379 --sink-uri=“kafka://192.168.104.113:9092/zlg_2?kafka-version=2.4.0&replication-factor=1” --changefeed-id=“cdc-canal-json” --config changefeed2.toml

我装的kafka的版本号kafka_2.12-2.8.0是这样的。。我看到文档里面最高是2.7.。不知道这个是不是有影响的啊

xfworld

(魔幻之翼)

8

你换低点的版本看看

kafka Client 在版本上对于 broker 的兼容做的还是可以的,我觉得不是这个问题,可以试试

另外这个 9092 确认没开防火墙,可以访问吧,可以检查下网络环境试试

zlgwarm

(Zlgwarm)

9

我一开始也怀疑是端口问题。。telnet 都是通的。。防火墙也是关闭的。我晚点重新再搞一下。。看看结果

懂的都懂

(wangtianyi)

10

您好,Flink 最佳实践之 通过 TiCDC 将 TiDB 数据流入 Flink 中有 ticdc 同步到 kafka 的 step by step 的配置方式。您可以看一下。

- 请先在 test database 下创建 t1(id int primary key, name varchar(20)) 进行测试,确保是有 pk 的

- 如果 cdc 同步正常,每隔一两秒中会会在 cdc 的 log 中打印出这期间一共同步了多少行数据。从您的日志中我没有看到相关的信息,这里我猜想数据还没有同步到 cdc 中,所以应该不是 kafka 的问题

- 此外,我看您说,kafka 的版本是 2.8.0(我装的kafka的版本号kafka_2.12-2.8.0),那么在您的 sink 中,请替换一下您的 kafka-version “kafka://192.168.104.113:9092/zlg_2?kafka-version=2.4.0&replication-factor=1”,这里的 2.4.0 换成 2.8.0。但这不是本次同步失败的原因,后面可能会引发异常。

system

(system)

关闭

11

此话题已在最后回复的 1 分钟后被自动关闭。不再允许新回复。