为提高效率,提问时请提供以下信息,问题描述清晰可优先响应。

- 【TiDB 版本】:tidb 4.0

- 【问题描述】:

我们在生产配制的集群

1.1 tidb。(1.2 预留 集群搭建好后加入集群)

1.3 pd (1.4 1.5 是预留集群搭建好后测试pd节点加入集群)

1.6 tikv

1.7 tikv

1.8 tikv

1.9 tikv

1.10 tikv (1.11 1.12 1.13 预留给以后加入集群做为tikv 节点)

(1)在创建 tidb 集群的时候,使用ansible搭建集群,搭建成功,集群各个节点也是健康状态。

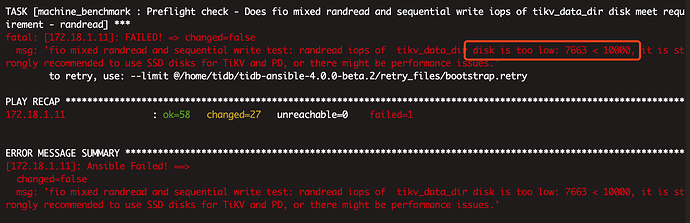

(2)我们把tik 节点1.11 加入集群,在检测中报错

我们的数据盘都是ssd 盘,正常来说应该检测通过的,会不会是盘有问题,或者是检测方式有问题,带着疑问,我们开始测试,把现有搭建成功的集群的tikv节点剔出来,然后再加入集群,是不是有同样的问题。

结论:通过测试,把1.10节点剔除来,再加入进入,还是报同样的错误,

只能认为是创建集群 时tikv节点的磁盘iops检测方式和 tikv节点加入集群时的iops 检测方式不同

才会在创建tidb集群的时候tikv磁盘iops检测通过,而在加入tikv节点的的时候会报错吧。

这样的问题如何解决,我看过历史的帖子了,说是不建议忽略iops检测问题

ERROR MESSAGE SUMMARY *******************************************************************************************************

[172.18.1.10]: Ansible Failed! ==>

changed=false

msg: ‘fio mixed randread and sequential write test: randread iops of tikv_data_dir disk is too low: 7897 < 10000, it is strongly recommended to use SSD disks for TiKV and PD, or there might be performance issues.’

Ask TiDB User Group for help:

It seems that you have encountered some problem. Please describe your operation steps and provide error information as much as possible on https://asktug.com (in Chinese) or https://stackoverflow.com/questions/tagged/tidb (in English). We will do our best to help solve your problem. Thanks. ![]()

172.17.1.11-iops测试.txt (2.8 KB) 添加节点初始化.txt (4.3 KB)

若提问为性能优化、故障排查类问题,请下载脚本运行。终端输出的打印结果,请务必全选并复制粘贴上传。